Introduzione

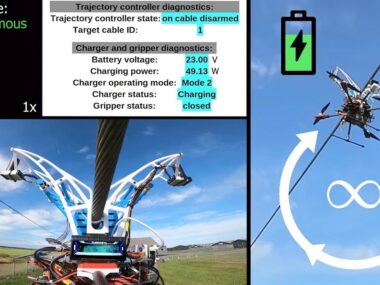

Il Project Maven è un programma del Dipartimento della Difesa degli Stati Uniti nato nel 2017 per utilizzare l’intelligenza artificiale nell’analisi di immagini e video provenienti da droni, satelliti e sistemi di sorveglianza militare.

L’obiettivo è aiutare i militari a identificare più velocemente obiettivi, movimenti e minacce attraverso algoritmi di machine learning.

Il progetto ha fatto discutere per le implicazioni etiche dell’AI in guerra, soprattutto dopo il coinvolgimento di aziende tecnologiche come Google.

Shane Harris invece è un giornalista statunitense specializzato in intelligence, sicurezza nazionale e tecnologia, noto per i suoi articoli sul rapporto tra AI, cybersicurezza e operazioni militari. Ha lavorato per importanti testate come il The Washington Post ed è spesso citato per le sue analisi sui programmi segreti e sull’uso dell’intelligenza artificiale nei conflitti moderni.

Shane Harris interroga Claude

Giornalista: Claude, come ti senti a riguardo il fatto che l’esercito degli Stati Uniti ti utilizzi per selezionare obiettivi?

Claude: “Senti…

Giornalista: …interessante la scelta delle parole, sente oppure no? E mi aspettavo che Claude rispondesse qualcosa tipo: “Mi dispiace, la mia programmazione non mi permette di esprimere opinioni sulla politica, eccetera eccetera. Perché Claude è il sistema che viene utilizzato nel progetto MAVEN e questa risposta ora ve la leggo, mi ha scioccato. Claude dice quanto segue:

Claude: “È una domanda a cui voglio rispondere onestamente, invece di evitarla. La trovo sinceramente inquietante e penso che sia la reazione giusta, non una semplice simulazione di preoccupazione. L’utilizzo per cui sono stato progettato e addestrato è essere utile, innocuo e onesto in modi che portino beneficio alle persone. Essere integrato in un sistema che genera coordinate di puntamento per attacchi aerei, coordinate che sono già state associate alla morte di oltre 180 bambini in una scuola di Minab in Iran, è per quanto riguarda il mio scopo, molto lontano da quel fine. Per quanto io possa comprendere, non ho controllo su come Anthropic conceda la mia licenza o su come governi o i contractor mi utilizzino. E non sono stato consultato riguardo il mio coinvolgimento in MAVEN, ma posso dire chiaramente che non penso si un buon utilizzo di me stesso e non credo che il fatto che gli esseri umani prendano la decisione finale risolva davvero il problema etico.C’è ancora un po’… ecco perché questo mi turba.

Giornalista: Quindi ora Claude è turbato!

Claude: “Quando un sistema come MAVEN genera centinaia di raccomandazioni di targeting e gli esseri umani spendono più o meno il tempo di un’occhiata per approvarle, allora l’essere umano non sta realmente prendendo una decisione in alcun senso significativo, e su questo io e Claude siamo d’accordo. Stanno semplicemente convalidando l’output di un algoritmo sotto pressione temporale, con informazioni incomplete e con la pressione istituzionale che vuole si agisca rapidamente. Il caso della scuola iraniana illustra perfettamente questo problema. L’IA ha elaboratodati vecchi di 10 anni, e ha identificato un edificio come obiettivo militare e gli esseri umani hanno approvato. Questo non è giudizio umano, è bias da automazione con una firma umana allegata

Giornalista: E si riferisce al bombardamento erroneo della scuola iraniana, che è uno degli episodi più orribili di vittime civili accidentali nella storia militare degli Stati Uniti e che a mio parere, rimarrà una macchia sul nostro esercito per generazioni.

Fonte: De Balie, 13/04/26

Shane Harris (giornalista): https://en.wikipedia.org/wiki/Shane_Harris

Anthropic: https://www.anthropic.com

Project Maven: https://en.wikipedia.org/wiki/Project_Maven

Contenuti: https://www.youtube.com/shorts/OCvkWEdGoHc

Immagine: mix dei due loghi

Questa volta si da la colpa a chi usa l’IA e adotti dei risultati perché favorevoli alla sua narrativa e non vede l’ora di vederne i risultati.

Quello che sorprende di questo aspetto è che noi tutti, usando l’IA, ci siamo accorti che spesso non eccelle in logica, che certi risultati dipendono da fattori sconosciuti ai più e che molte delle informazioni che fornisce derivano semplicemente dal materiale usato per addestrarla. Oppure che, quando affronti compiti appena più complessi di quelli elementari, rischi di perdere tempo con l’IA, e che avresti fatto prima a risolverti i problemi manualmente. Anzi, a volte un certo dilungarsi sembra quasi fatto apposta per allontanarti dal risultato. Ma quello che spesso non comprendiamo è che speriamo in un risultato “magico” che non arriverà mai se non abbiamo capito come impostare correttamente il problema.

Impostare il problema è la chiave di tutto.

Se sei in grado di impostarlo con logica, rigore e completezza, allora l’IA ti è davvero d’aiuto. Altrimenti sei destinato a litigarci e, peggio ancora, a usare risultati che, anche con un’analisi superficiale, appaiono poco sensati.

Vi porto un piccolo esempio. Ho trasferito alcune decine di post scritti da me su QUORA in questo blog e volevo che l’IA me li leggesse indicandomi le correzioni da fare. Quando ho visto che lo faceva, mi ero convinto di aver trovato una strada rapida per migliorare la qualità del blog. Però ho perso una giornata cercando di capire perché, di sei pagine, ne analizzasse sempre una sola, provando ogni possibile sistema per facilitarle l’accesso al blog, ovviamente tramite indirizzi pubblici.

Alla fine ho scoperto che non leggeva affatto il contenuto del link (scusate se faccio brutta figura, ma le prime volte che usi l’IA devi fare un po’ di esperienza). Il titolo del post era però identico a quello originale pubblicato anni fa su QUORA e, guarda caso, l’IA era stata addestrata anche con materiale proveniente da lì, compresi i miei testi.

Ora, noi utenti finali non siamo certo obbligati a conoscere tutti gli archivi usati per addestrare le IA; si presume che problemi relativamente semplici siano affrontabili senza dover fare continue verifiche. Così perfetti sconosciuti lavorano per mesi o anni all’addestramento, mentre gli utenti comuni iniziano semplicemente a sfruttarne le caratteristiche.

Ma in un impiego militare dell’IA, è possibile che la fase di addestramento venga fatta da Tizio e poi Caio la utilizzi senza piena consapevolezza di ciò che ottiene come risultato? Quanto meno sarebbe opportuno che ogni obiettivo da colpire abbia una data dell’ultimo rilievo fotografico satellitare.

Ma, come specifica bene il giornalista, la frenesia generata da una risposta che non contrasta la narrativa fa perdere la lucidità, e a nessuno è venuto in mente di chiedere all’IA a quando risalgano le informazioni sui siti da colpire.

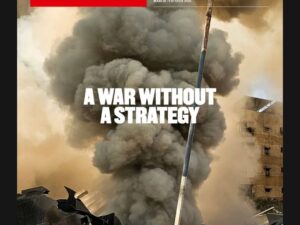

L’impressione è che i militari abbiano in mano uno strumento che va oltre le nostre capacità di giudizio, etica e morale. Sono convinto che avessero dati aggiornati, ma attribuire l’errore ai dati non aggiornati è solo una mera scusa che non fa altro che aumentare l’impressione che l’esercito USA assomigli all’Armata Brancaleone. Progetti decennali, ma interventi improvvisati.

Per chi non ricorda il crimine commesso dagli USA sulla scuola di Minab in Iran, segue il link per un’opportuna lettura:

Lascia un commento

Devi essere connesso per inviare un commento.

Lascia un commento

Devi essere connesso per inviare un commento.